Por Que a Frequência de Amostragem Importa Mais Do Que Você Imagina | Lab Wizard

Índice

📋 Quando os gráficos parecem bons mas as peças não

A corrida de galvanoplastia em tambor terminou no prazo. O operador registrou tensão, corrente e temperatura nos intervalos padrão. Todas as leituras ficaram dentro dos limites de controle. Os gráficos pareciam estáveis. As peças saíram da linha e o laboratório de qualidade mediu variação de espessura de banho acima da especificação do cliente em 30%.

Os dados nunca mostraram nada errado. As peças contaram outra história.

Amostras esparsas podem fazer um processo em deriva parecer estável no papel.

Isso não é falha de coleta de dados. O operador seguiu o procedimento. Os instrumentos estavam calibrados. Os limites de controle eram adequados. O problema era mais sutil: o cronograma de amostragem criou uma ilusão de estabilidade que escondeu um desvio real de processo. Os dados estavam corretos em todo ponto em que existiam, e essa exatidão foi exatamente o que os tornou enganosos.

Quando um lote falha nessas condições, a investigação costuma ir para química, equipamento ou técnica do operador. Raramente vai para o momento em que os dados foram tirados. Ainda assim, o intervalo entre os pontos de dados é muitas vezes onde está a história real.

Ponto central: O seu intervalo de amostragem decide o que existe no registro e o que nunca chega a ser anotado.

⚙️ Por que o intervalo entre amostras é onde os desvios se escondem

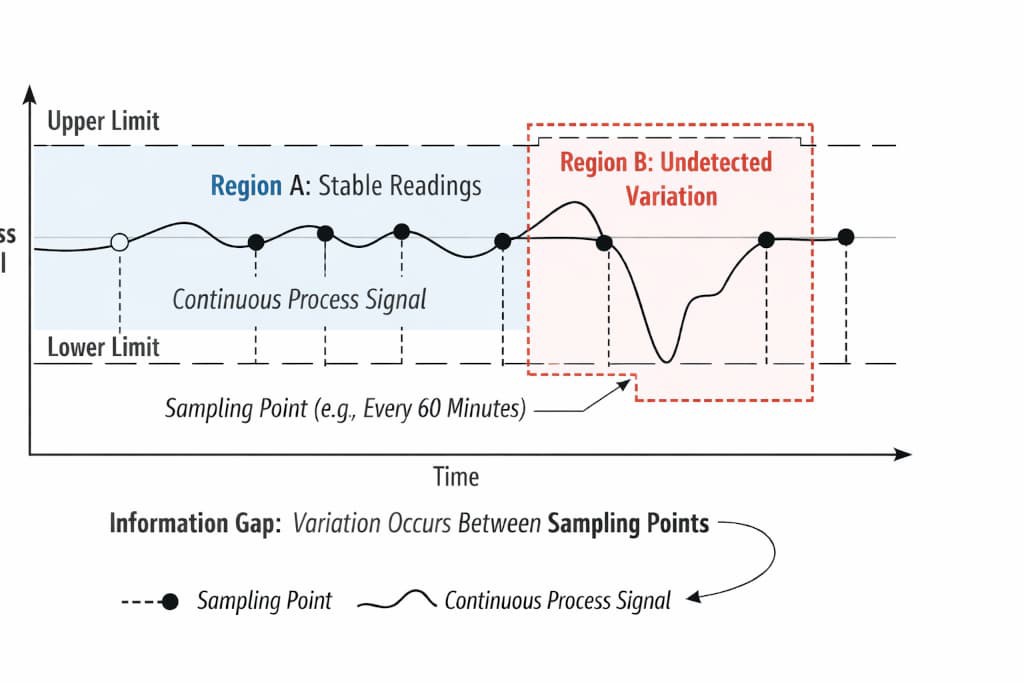

Um processo contínuo de galvanoplastia não produz dados contínuos a menos que você o instrumente para isso. O que você coleta é uma série de instantâneos discretos em intervalos fixos. Entre um instantâneo e outro, o processo está em funcionamento, mudando e potencialmente se desviando, mas não há registro desse tempo nos seus dados.

Isso cria uma assimetria fundamental. Você avalia a estabilidade de um sistema contínuo usando observações discretas, e os intervalos entre essas observações determinam o que você pode e não pode ver.

Pense no efeito estroboscópico. Quando você ilumina um objeto em movimento em intervalos regulares, vê a posição dele em cada flash. Se o objeto se move rápido entre flashes e volta a uma posição parecida, a sequência de posições pode parecer movimento uniforme. Mas entre essas posições, o objeto pode ter percorrido uma distância muito maior, encontrado um obstáculo ou mudado de direção por completo. Seus dados não mostrariam nada porque você não capturou o que aconteceu entre os flashes.

O processo de galvanoplastia funciona da mesma forma. Um pico de corrente no retificador que dura cinco minutos, um desvio de temperatura durante o reabastecimento do banho, uma mudança súbita na carga de peças que altera a distribuição de corrente, um esgotamento químico que se acumula entre ciclos de reposição; qualquer um desses eventos pode ocorrer no intervalo entre amostras e não deixar rastro nos seus registros.

Entre os flashes, o processo roda sem registro; o que acontece aí é invisível para os seus gráficos.

Ideia-chave: Dados estáveis não provam um processo estável. Provam que o processo estava estável nos momentos em que você olhou.

A relação entre intervalo de amostragem e probabilidade de detecção não é abstrata. É uma função mensurável. Quanto maior o seu intervalo de amostragem em relação à duração dos desvios de processo, menor a probabilidade de qualquer desvio ser capturado. Isso vale independentemente da precisão dos instrumentos, de quão bem os limites de controle estejam definidos ou de quão cuidadosamente os operadores sigam o procedimento.

Quando os desvios são mais curtos que o intervalo de amostragem, a detecção exige que coincidam com um momento de amostragem. Quando os desvios são mais longos, ficam mais fáceis de capturar. Quando são muito mais longos que o intervalo, a detecção é quase certa. Mas na faixa em que a duração do desvio se aproxima ou fica abaixo do intervalo de amostragem, a detecção se torna probabilística em vez de certa.

Essa detecção probabilística é a fonte da ilusão. O seu processo gera desvios, mas o cronograma de amostragem só pega uma fração deles. Os que passam despercebidos nunca aparecem nos gráficos. O que resta é um conjunto de dados que parece estável, embora o processo subjacente não seja.

O que os dados mostram: Corrente do retificador a 245 A às 8:00. Corrente a 248 A às 9:00. Corrente a 246 A às 10:00. Todas as leituras dentro dos limites de controle. O processo parece estável.

O que realmente aconteceu: Entre 8:15 e 8:45, o retificador teve um pico sustentado de corrente até 270 A por um problema de contato na cremalheira que só foi resolvido na leitura das 9:00. As peças banhadas nesses trinta minutos receberam corrente em excesso que não apareceu em nenhum ponto registrado.

A discrepância entre essas duas descrições é a lacuna de amostragem em ação. Seus dados são precisos. O seu processo não estava estável. As duas afirmações são verdadeiras ao mesmo tempo, e o hiato entre elas existe por causa de com que frequência você amostra.

🔍 Como a lacuna de amostragem aparece na operação real

O mecanismo descrito acima se manifesta na sua operação por padrões reconhecíveis. A questão é aprender a distinguir processos genuinamente estáveis daqueles que só parecem estáveis por causa do cronograma de amostragem.

Se o momento da falha não bate com os dados, suspeite do intervalo antes de suspeitar da química.

Um dos indicadores mais comuns é o momento das falhas. Quando um lote falha em um parâmetro que o sistema de monitoramento deveria ter capturado, mas os dados não mostram alerta, a frequência de amostragem é o primeiro suspeito. Os dados não mentiram. Simplesmente não capturaram o que aconteceu.

Outro padrão aparece quando você aumenta a frequência de amostragem e de repente vê problemas que não sabia que existiam. Isso não significa que o processo tenha se tornado instável no momento em que passou a amostrar mais. Significa que o processo já era instável e o cronograma anterior era insuficiente para revelar isso.

Você também pode reconhecer esse mecanismo pela estrutura dos seus próprios dados. Olhe para o desvio padrão dos valores registrados. Se o desvio padrão for muito pequeno em comparação com o que esperaria de um processo em execução contínua, o intervalo de amostragem pode estar filtrando a própria variação que você precisa ver. Você não está vendo menos variação porque o processo é mais estável. Está vendo menos porque o cronograma de amostragem está perdendo os períodos instáveis.

Isso está intimamente ligado à dinâmica de sinal vs ruído. O cronograma de amostragem pode suprimir tanto o sinal significativo quanto o ruído aleatório, deixando um conjunto de dados enganosamente limpo.

A pergunta de auditoria é direta, mas muito ignorada: qual é a razão entre o seu intervalo de amostragem e a menor duração de um desvio de processo relevante? Se o intervalo é de uma hora e o reabastecimento do banho leva vinte minutos e desloca a temperatura em três graus, o cronograma de amostragem está desenhado para perder esse evento na maior parte do tempo.

Probabilidade de detecção por intervalo de amostragem

Como intervalo de amostragem e duração do desvio interagem para definir a probabilidade de detecção. À medida que o intervalo entre amostras cresce em relação à duração do evento, a probabilidade de detecção cai acentuadamente.

| Intervalo de amostragem | Duração curta do desvio | Probabilidade de detecção |

|---|---|---|

| 30 minutos | 15 minutos | Moderada: sobreposição parcial provável |

| 1 hora | 15 minutos | Baixa: exige sincronia precisa |

| 1 hora | 30 minutos | Moderada: metade do desvio capturada |

| 1 hora | 2 minutos | Muito baixa: quase impossível pegar |

| 2 horas | 15 minutos | Mínima: quase certamente perdido |

| 4 horas | 15 minutos | Ínfima: desvio invisível aos dados |

A tabela acima é ilustrativa, não prescritiva. O ponto é estrutural: à medida que o intervalo entre amostras cresce em relação à duração dos eventos que você precisa detectar, a probabilidade de detecção cai acentuadamente. Isso é função da relação entre intervalo e duração do desvio, não de quantos pontos você coleta no total.

Na prática: Ao investigar falhas de qualidade sem explicação, revise o cronograma de amostragem antes de revisar a química. Os dados podem ser precisos, mas dados precisos coletados na frequência errada não dizem o que aconteceu entre as amostras.

📉 Quando dados “estáveis” escondem refugo, retrabalho e pontos cegos

O custo de desvios não detectados raramente aparece nos dados que dispararam a investigação. Esse é o paradoxo central das lacunas de amostragem: o próprio mecanismo que esconde o problema também esconde o custo do problema.

Você paga duas vezes: uma em refugo ou retrabalho, outra quando a causa raiz nunca aparece no registro.

Quando um lote falha por um desvio que o cronograma de amostragem não capturou, a investigação costuma seguir a trilha da evidência disponível. Os dados parecem normais. A química confere. O diagnóstico de equipamento não mostra falhas. A investigação pode ir para variação de matéria-prima, técnica do operador ou fatores ambientais. A frequência de amostragem quase nunca está na lista curta, porque os dados não dão sinal que aponte para ela.

Isso cria uma estrutura de custo cumulativo. O custo imediato é o lote perdido, refugo, retrabalho ou devolução do cliente. Mas o custo oculto é a incapacidade de evitar que a mesma falha se repita, porque a análise de causa raiz não identificou a lacuna de amostragem como fator contribuinte. Esse é o núcleo da dinâmica de custo de detecção tardia. O custo não é só o refugo; é a incapacidade de aprender com a falha porque o mecanismo que a causou permanece invisível.

Com o tempo, esse padrão pode corroer a capacidade do processo sem um único evento que dispare ação corretiva formal. O processo não está piorando. É o mesmo de antes. Mas a sua capacidade de detectar e tratar variação se degrada à medida que o hiato entre o cronograma de amostragem e a dinâmica real do processo se alarga.

O impacto em auditoria é outra dimensão. Quando um auditor revisa os dados do processo e vê leituras consistentes dentro dos limites de controle, não há motivo para questionar a estabilidade. A frequência de amostragem da coleta raramente é examinada como parte da trilha de auditoria. Os dados que existem são precisos, bem documentados e adequadamente controlados. Os dados que não existem. Os intervalos entre as suas amostras. Eles são invisíveis para a revisão de auditoria.

Isso não é crítica às práticas de auditoria. É reconhecer que metodologias padrão avaliam os dados apresentados, não os dados que não foram coletados. A sua frequência de amostragem determina o que a auditoria vê; se for grosseira demais, a auditoria verá um processo estável mesmo quando houver instabilidade.

O impacto financeiro se acumula em várias dimensões. Refugo por desvios não detectados. Retrabalho de peças que atendem parcialmente à especificação. Dano à relação com o cliente por qualidade inconsistente que não se liga a uma ação corretiva específica. E o custo de oportunidade da atenção da gestão voltada a química e equipamento quando a restrição real é o cronograma de coleta de dados.

🚩 Erros que mantêm a lacuna de amostragem invisível

❌ Confundir dados estáveis com processo estável. Quando os gráficos de controle mostram leituras consistentes, a suposição natural é que o processo vai bem. Essa suposição só vale se a frequência de amostragem for suficiente para capturar desvios relevantes de processo. Caso contrário, você está confundindo estabilidade dos dados com estabilidade do processo.

❌ Usar intervalos fixos em processos com dinâmica variável. Um intervalo de uma hora pode ser adequado em produção em regime permanente e completamente inadequado em trocas de lote, reabastecimentos de banho ou partidas de equipamento. Processos com dinâmica variável exigem cronogramas que considerem períodos de maior variação, não só condições médias.

❌ Aumentar a frequência de amostragem sem entender o mecanismo. Algumas equipes respondem a problemas de qualidade coletando dados com mais frequência. Isso pode revelar variação oculta, mas também aumenta o volume de dados sem necessariamente melhorar a qualidade da decisão. Entender a relação entre intervalo de amostragem e desvios de processo importa mais do que simplesmente acumular pontos.

❌ Tratar dado faltante como prova de que nada aconteceu. Quando um ponto programado é pulado ou um sensor sai do ar, a interpretação comum é de que nada de incomum ocorreu naquele período. Dado faltante não é evidência de estabilidade. É evidência de incerteza. A diferença importa quando você tenta saber se houve desvio de processo que não foi registrado.

Um cronograma único pode parecer responsável enquanto pula de forma sistemática os momentos que mais importam.

Ideia-chave: A frequência de amostragem da sua coleta de dados é um parâmetro de processo por si só. Merece a mesma atenção e revisão periódica que qualquer outra variável de controle na operação.

🔗 Recursos relacionados

- Quando o Monitoramento Deve Virar Ação: Pontos de disparo para intervenção e o momento das decisões com base em dados de processo

- Sinal vs Ruído em Dados de Processo: Como distinguir variação significativa de ruído aleatório do processo

- Por Que a Detecção Tardia Multiplica o Custo de Refugo e Retrabalho: Impacto financeiro da detecção tardia de desvios de processo

- Entendendo Parâmetros CEP: Cp, Cpk, Cpm, Pp e Ppk Explicados: Definições centrais e interpretações dos parâmetros de controle estatístico de processo

Links externos

- NIST: Interpreting Control Charts: Orientação em padrão governamental sobre interpretação de gráficos de controle e padrões em gráficos de controle

- ASQ: Variation (Common vs Special Cause): Recurso da associação de qualidade sobre variação de causa comum versus causa especial

- AIAG: Statistical Process Control: Manual da indústria sobre princípios de CEP e aplicação prática em ambientes de manufatura